forskning

Hvorfor vi bygger nullkunnskapsbevis for språkmodeller

AI med kvittering

Jeg vil starte med et lite, kjedelig spørsmål: hvordan vet du at akkurat den AI-modellen tjenesteleverandøren sier de bruker, faktisk er den som svarte deg i går?

Du vet det ikke. Du stoler på det. Det er greit i mange sammenhenger, men ikke når Datatilsynet skal etterprøve en automatisk avgjørelse etter GDPR artikkel 22, ikke når en bank må legge fram revisjonsspor under DORA fra 2025, og ikke når en lege skal forklare hvorfor en pasientjournal anbefaler en bestemt diagnose. I disse sammenhengene trenger vi noe sterkere enn tillit. Vi trenger en kvittering; ett tall, eller noen få, som tredjepart kan etterprøve uten å gå gjennom hele modellen, og uten tilgang til verken vekter eller pasientdata.

Den kryptografiske primitiven som leverer akkurat det heter nullkunnskapsbevis (zero-knowledge proofs, ZK). Og fram til ganske nylig var de altfor dyre til å brukes på en moderne språkmodell.

Det er det vi har jobbet med i tenki det siste halvåret. I dag har vi publisert v2.1 av forskningsartikkelen vår, og jeg vil gjerne fortelle hva vi har bygd, hva vi har målt, og hvorfor jeg tror dette er en byggestein norsk og nordisk KI kommer til å trenge.

Hva vi har bygd

Tre konstruksjoner og én ny trusselmodell.

PSI-LM er en grunnlinje: prøvebaseringssoliditet over posisjoner i en autoregressiv sekvens. Beviseren forplikter seg kryptografisk til hver token-prediksjon; verifikatoren utfordrer en liten tilfeldig delmengde og sjekker dem. Det høres enkelt ut, og det er enkelt, men det dekobler beviskostnaden fra sekvenslengden, og det er hovedpoenget. Tidligere ZK-systemer for LLM (zkLLM, zkGPT, zkPyTorch) målte alle kostnaden for én forwardpass. Naiv komposisjon over et tusen-token-svar lander rundt ti dager med beviskjøring per respons. PSI-LM gjør det til timer.

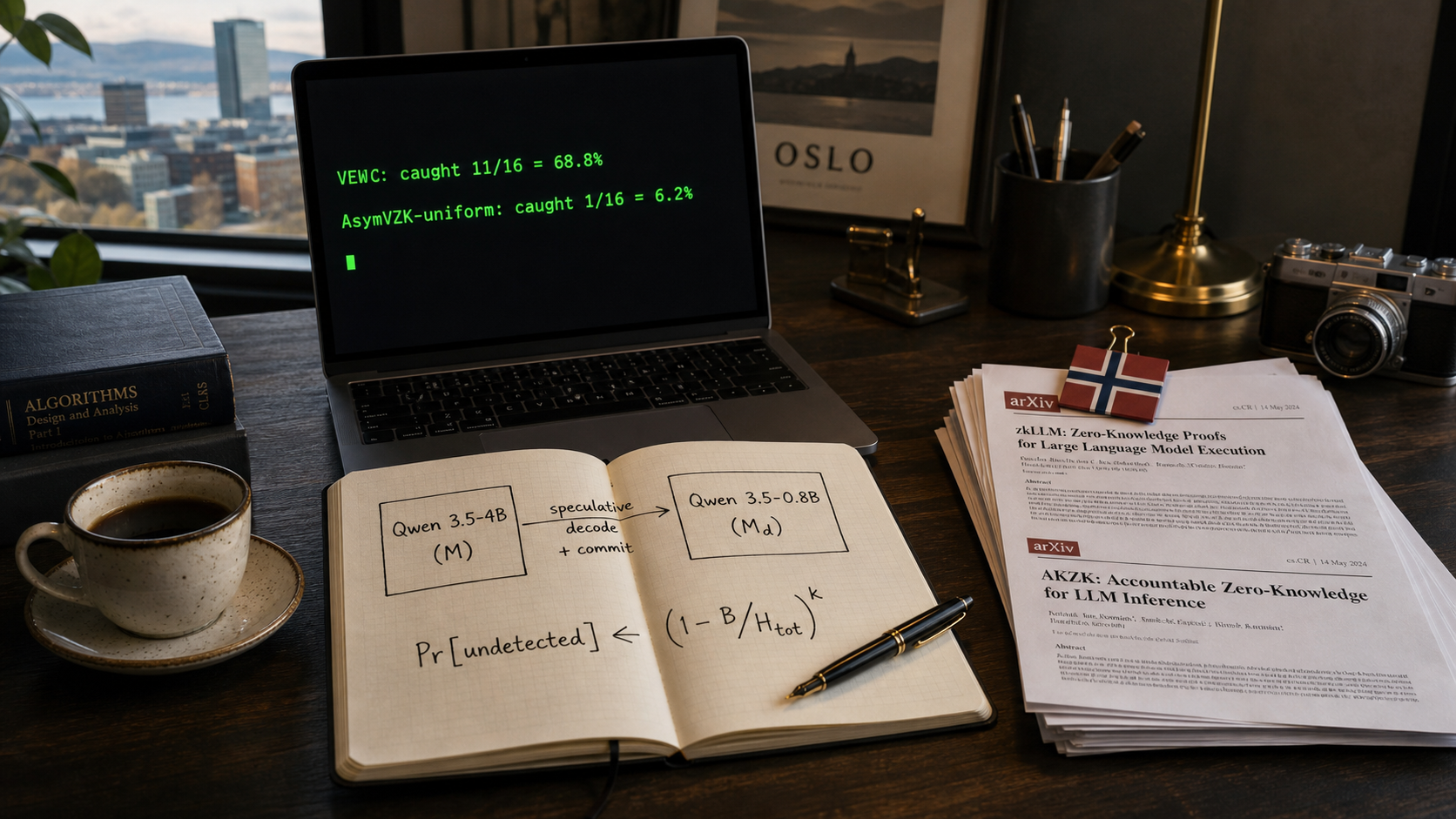

AsymVZK går videre. Den utnytter at verifikatoren kan kjøre en liten draft-modell lokalt og gratis (Qwen 0.5B), mens beviseren kjører den store modellen (Qwen 1.5B eller 4B) under en kryptografisk forpliktet aksept/forkast-test som er den samme som speculative decoding bruker for å akselerere. Dette gir oss en helt ny trusselmodell: AKZK - asymmetrisk-kunnskap nullkunnskap, hvor verifikatoren har et offentlig deterministisk hjelpe-orakel. Standard nullkunnskap er trivielt-orakel-tilfellet; AsymVZK lever et hakk lenger ute.

VEWC er den varianten jeg er mest stolt av: verifiable entropy-weighted challenges. Vi vekter utfordringsdistribusjonen mot posisjoner med høy Shannon-entropi er der modellen kunne ha sagt mange forskjellige ting. Dette fanger en motstanderklasse som standard cut-and-choose nesten ikke ser: en juksende prover som lyver på ett semantisk lastet token og lar resten være riktig.

Hva vi målte

På RTX 5070 Ti, forsøk per celle, 95 % bootstrap-konfidensintervaller. Headline-tallene:

- Mot semantisk-innholds-motstander, : VEWC fanger 74,6 % [70,8; 78,4]; AsymVZK-uniform fanger 7,4 % [5,0; 9,8]. Det er en faktor på 10,1×.

- Akseptrate i speculative decoding: 70–86 % på fem prompt-domener. Det betyr at AsymVZK kun trenger kryptografiske bevis ved omtrent en fjerdedel av posisjonene.

- Hastighetsgevinst: over naiv autoregressiv zkLLM-baseline ved .

Og noe jeg synes det er viktig å si høyt: VEWC har en målbar blindsone. På en lav-entropi-motstander, er én som lyver på de minst informasjonsrike tokenene så fanger VEWC bare 0,6 % av løgnene selv ved . Det er en ærlig konsekvens av designet, ikke en feil. I produksjon kjører man VEWC og AsymVZK-uniform i parallell.

Hva betyr dette for KI generelt

Verifiserbare språkmodeller har hittil vært en akademisk øvelse ikke store tall, ingen produksjonssvar. Vi har ikke løst hele problemet, men vi har flyttet et målbart kostnadspunkt med over en størrelsesorden, og vi har gitt feltet en ny formell ramme (AKZK) å regne i. Det betyr at det blir billigere å stille spørsmålet: «kan denne tjenesten levere et bevis sammen med svaret?» Og når noe blir billigere, begynner folk å kreve det.

Jeg tror den interessante implikasjonen ikke er teknisk, men kontraktuell. Når kostnaden faller under en terskel der en regulator eller en stor kunde kan kreve nullkunnskapsbevis i SLA-en, så vil de gjøre det. AKZK-rammen gjør den terskelen vesentlig lavere.

Hva betyr dette for norsk KI spesifikt

Det er her jeg blir litt mer pågående.

Datatilsynet har siden 2021 krevd forklaringsevne for automatiserte avgjørelser etter GDPR artikkel 22. AsymVZK lar et tilsyn etterprøve en allerede-utført inferens lokalt, uten å re-eksekvere modellen og uten tilgang til verken parametre eller bruker-prompt. Det er nettopp den eiendommen et tilsyn trenger, og som ingen annen primitiv (FHE, MPC, TEE) leverer på samme måte.

DORA trer i kraft 2025 og krever revisjonsspor for finansielle algoritmer, inkludert utkontraktert KI. En bank som leverer kredittmodellering med et ledsagende AsymVZK-bevis kan tilfredsstille DORA uten at regulatoren må stole på utkontrakteringsoperatørens infrastruktur.

Helseplattformen-debatten og MSBs anbefalinger om on-prem KI for forsvarstilknyttede formål peker på en bredere bevegelse: norsk og nordisk offentlig sektor vil ikke sende sensitive data til amerikanske skytjenester. AsymVZKs asymmetri lar deg sende selve beviset, ikke dataene, til verifikatoren. Det passer akkurat denne suverenitetsdynamikken.

Jeg tror den mest interessante bruken på kort sikt er i automatiserte vedtak i offentlig sektor: NAV, helseforetakene, kommunale tjenester. Når en avgjørelse som påvirker en innbygger blir tatt av en språkmodell, er det rimelig å kreve at avgjørelsen kommer med en kvittering som Datatilsynet, en advokat, eller innbyggeren selv kan etterprøve. Tre måneder senere. Uten å belaste produksjonsmiljøet.

Hva vi ikke hevder ennå

Jeg vil være helt åpen om hva som ikke er løst:

- Per-posisjons-SNARK-en i AsymVZK er fortsatt en stub i v2.1. Vi har spesifisert grensesnittet og har et tydelig integrasjonsmål mot Halo2 eller Plonky3, men selve integrasjonen er videre arbeid.

- Den formelle separasjonen mellom AKZK og standard nullkunnskap er en åpen sort-boks-skisse. Vi tror den følger, men vi har ikke skrevet ned beviset.

- Aksept-mønsteret lekker informasjon. En sofistikert observatør kan trekke ut lavoppløste signaler om innholdet ved å se på akseptmønsteret over tid. Vi har en threshold-forpliktet variant på blokken, men den er ikke ferdig.

Disse tre er nettopp de tingene som gjør at v2.1 ikke er en endelig artikkel. v3 kommer når minst én av dem er løst.

Hvor du leser videre

Hele artikkelen, all kode, alle eksperimenter, og alle figurer ligger med API'en på tenki.no/forskning/zkllms-forskning. Reproduksjonspakken kan kjøres på en hvilken som helst CUDA-kapabel maskin med Qwen 2.5/3.5 lastet ned.

Hvis du jobber med regulering, finansiell compliance, helsesystemer, eller offentlig sektor og lurer på hvordan dette kan brukes i din kontekst så send meg en e-post: [email protected]. Jeg vil høre fra deg.

— Einar Holt, Founder & Partner, tenki